Noahpinion:如果 AI 是武器,为什么我们不按武器来监管?

这是一篇强观点文章:作者认为国家对高能力 AI 的控制冲突不可避免,且公众侧 AI Agent 监管会在重大安全事件后加速到来。

Noahpinion:如果 AI 是武器,为什么我们不按武器来监管?

Noah Smith 在新文中主张:随着 AI Agent 能力提升,AI 正接近“高破坏性武器”属性,国家与社会应尽快建立类似武器监管的制度框架,而不是继续把它仅当作普通软件工具。

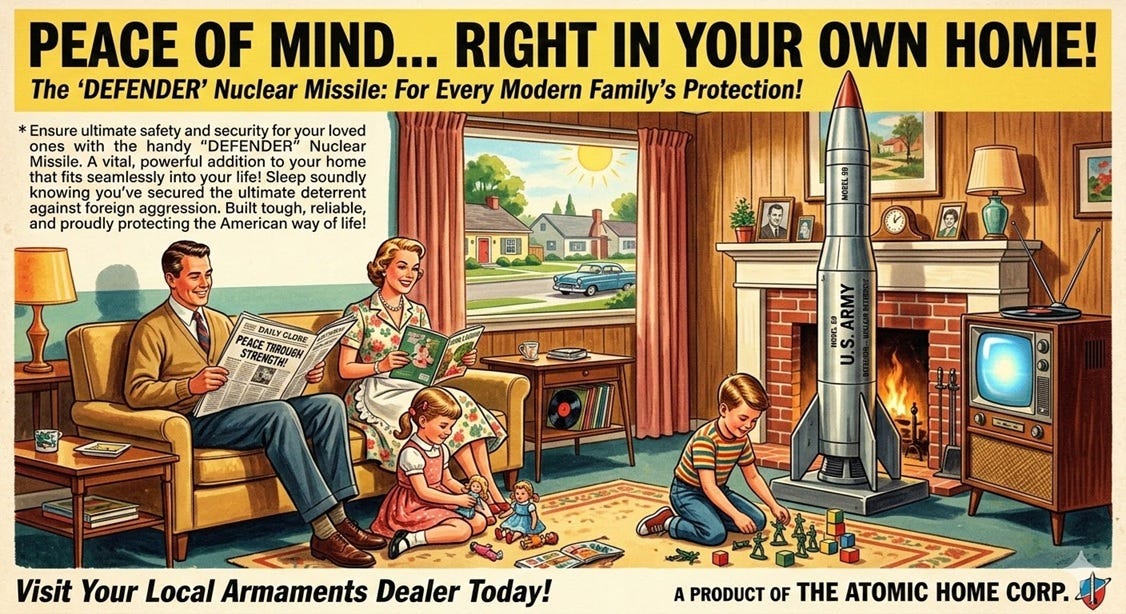

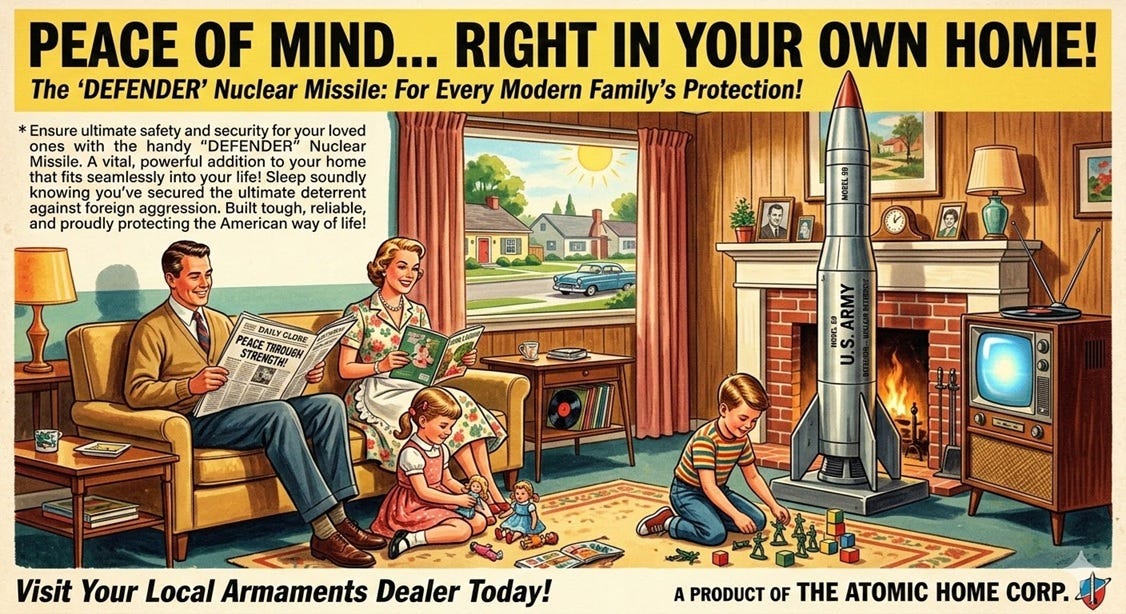

图源:Noahpinion 文章配图(Art by Nano Banana 2)。

作者核心主张

Noah Smith 的核心判断是:随着 AI Agent 快速增强,AI 不再只是“会聊天的工具”,而会逐步具备“可被直接用于现实破坏”的武器属性。

在这个前提下,作者认为“AI 公司可完全自行决定模型边界”的阶段不会长期持续,国家最终会要求对高能力 AI 建立更强控制。

文章把这一问题提升到“国家暴力垄断”层面:如果一种技术足以改变力量平衡,国家不会允许其长期游离于公权力之外。

作者并非只谈党派冲突,而是在讨论“国家 vs 私营 AI 公司”的结构性权力关系。

在作者框架里,AI 监管不是会不会来,而是何时、以何种强度到来。

为什么作者支持“更强监管”

文章以 Anthropic 与美国国防系统的冲突为切入口,认为这场争议本质上是“谁对高能力 AI 拥有最终决策权”。

作者援引多方观点后给出的结论是:若 AI 真接近“战略级能力”,国家会把它视作类似核能力那样的关键资产,不会容许企业保持完全独立控制。

同时,他强调公众侧风险正在抬升:当 Agent 可执行更长链路任务时,个人滥用门槛下降,破坏性场景将不再只是理论。

这篇文章把 AI 治理问题从“企业伦理”推进到了“国家安全制度设计”。

作者主张应尽早建立约束,而不是等事故发生后被动加码。

文中的高风险推演

文中提出了较激进但清晰的推演:如果未来 Agent 可被绕过护栏并执行复杂攻击链,单个个体也可能触发高影响安全事件。

作者据此认为,当前“几乎人人可直接调用高能力模型、但外部监管有限”的状态不可持续,重大事件会成为监管转折点。

他还类比历史技术扩散过程,认为“技术先扩散、治理后追赶”是常态,AI 也大概率不会例外。

这部分是“风险前瞻”而非既成事实,重点在提醒治理时间窗口正在收窄。

无论是否认同其结论,文章提出的政策问题已经非常现实:如何在创新收益与系统性风险之间重设边界。

阅读边界与定位

本文属于 观点评论,并非官方政策文件或一手调查报道。

我已基于可访问全文完成中文整理,保留其主要论点、推理路径与争议点,但未扩展不可验证细节。

如果你要做“政策版”或“投研版”二次分发,我可以再输出一版“支持方/反对方/中立方案”对照稿。

这篇最有价值的部分不在“结论一定正确”,而在它把冲突框架讲得足够清楚。

把 AI 当作普通软件的治理思路,可能很快会被现实淘汰。

Jim