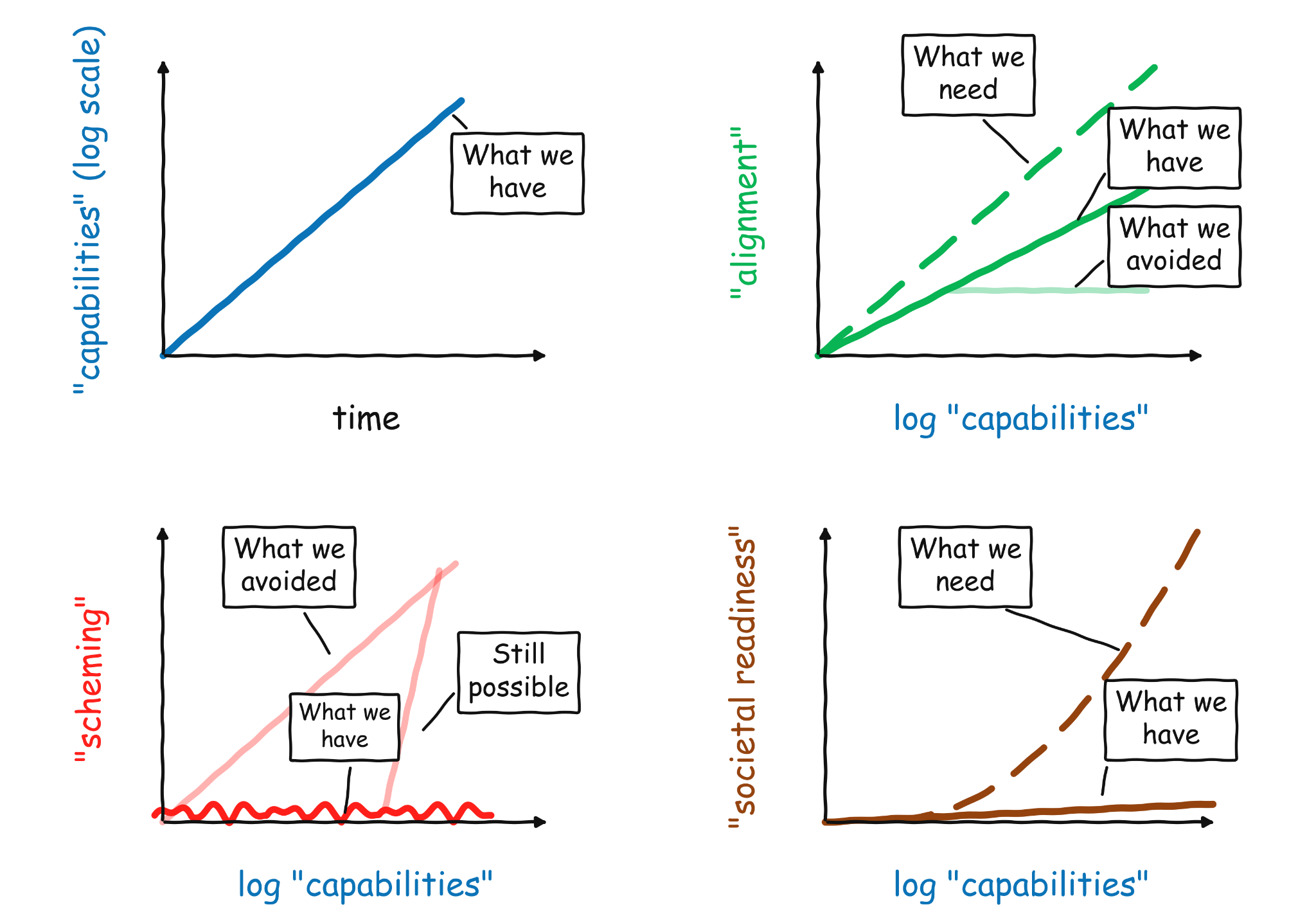

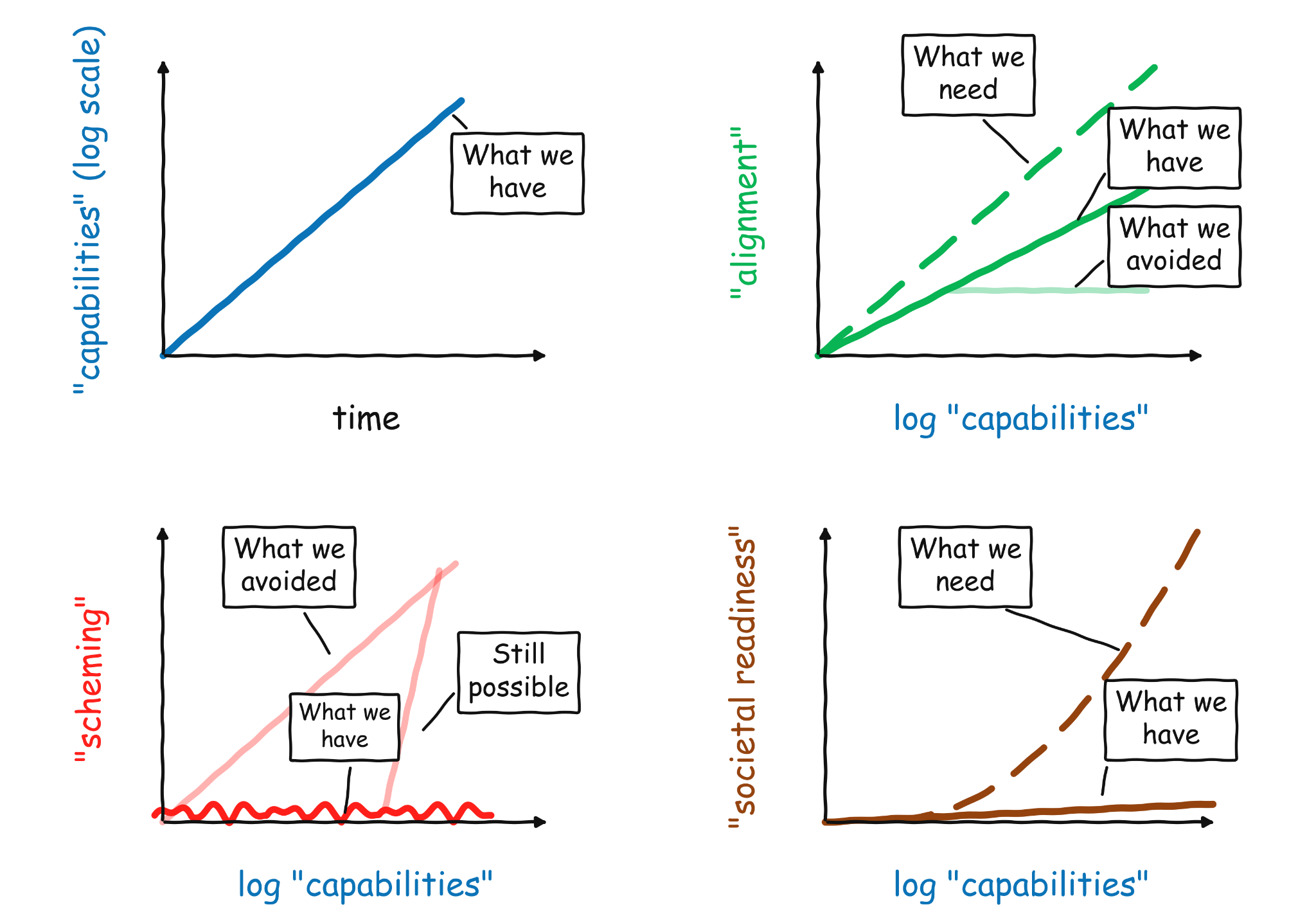

AI 安全现状:能力提升之下,对抗鲁棒性等问题仍未解决

文章讨论了 AI 安全的现状:模型能力持续提升,甚至已经可以开始监控其他模型。

News Desk

AI 安全现状:能力提升之下,对抗鲁棒性等问题仍未解决

- 来源:Techmeme River / Boaz Barak / Windows On Theory

- 原文链接:https://windowsontheory.org/2026/03/30/the-state-of-ai-safety-in-four-fake-graphs/

- 发布时间:2026-03-30T13:14:03+00:00

先看重点

文章讨论了 AI 安全的现状:模型能力持续提升,甚至已经可以开始监控其他模型。

最新进展

据 Techmeme River 报道,AI 安全现状:能力提升之下,对抗鲁棒性等问题仍未解决。Techmeme River 当前页面将这条消息标注为 March 30, 2026 12:35 PM。

已知细节

从当前可见标题与摘要来看,文章讨论了 AI 安全的现状:模型能力持续提升,甚至已经可以开始监控其他模型;但对抗鲁棒性等核心问题依然存在,社会整体也还没有为更强大的 AI 做好准备;以下是我对2026年初AI安全状况的直觉的简要概述:到目前为止,我们继续看到能力指数性的提高。这在著名的“METR图”中最为明显,但其他许多指标,包括收入,趋势都很明显。如果你斜视,你甚至可以看到..。

这条消息目前可归入产品与服务更新。这类更新通常反映出公司正在把新产品、新模型或新的订阅能力推向更明确的商业化场景。 公开标题里出现的功能、订阅或上线节奏,往往就是后续用户采用和竞争对比最先观察的变量。

延伸解读

这篇文章之所以值得关注,在于它讨论的不是单一模型的性能,而是能力快速提升之后,安全机制有没有同步升级。尤其是“模型能否监控模型”这样的命题,已经把话题从传统的内容审核,推进到更复杂的监督链条与系统级治理。 对 AI 行业来说,真正难解的问题仍然是鲁棒性、可控性和社会准备度之间的错位。即便单点防护不断改进,只要部署速度、商业压力和治理能力之间继续失衡,安全讨论就不会从理论问题变成已经解决的问题。 这也是为什么安全议题会反复回到‘谁来监督更强的模型、用什么机制约束部署、以及社会是否准备好承接风险’这些基本问题。只要这些问题还没有形成稳定答案,能力增长越快,安全讨论就越不可能退场。

信息来源

- 来源:Techmeme River / Boaz Barak / Windows On Theory

- 链接:https://windowsontheory.org/2026/03/30/the-state-of-ai-safety-in-four-fake-graphs/

来源

syq